오픈AI "AI 환각, 평가 방식 때문"…'추측 보상' 시스템이 문제

💡

오픈AI가 자사 AI 모델들이 거짓 정보를 그럴듯하게 생성하는 '환각(hallucination)' 현상에 대한 근본 원인을 분석한 연구 논문을 공개했습니다. 이 논문에서 오픈AI는 환각이 AI 모델 자체의 한계가 아닌, 현재 업계 표준인 '정확도 중심 평가 방식'이 만든 구조적 문제라고 주장했습니다.

✅ 객관식 시험의 함정: "추측이 더 유리하다"

환각은 챗GPT나 GPT-5 같은 대화형 AI가 마치 확신하는 듯 답변하지만, 그 내용이 사실과 다른 현상을 말합니다. 예를 들어 한 연구자의 박사 논문 제목을 묻자 챗봇이 세 가지 답변을 제시했지만 모두 틀렸던 사례가 대표적입니다.

![[자료] '제로 클릭' AI 검색이 뉴스 비즈니스에 미치는 영향과 대안](https://cdn.media.bluedot.so/bluedot.thecore/2025/11/ivacbx_202511130202.png)

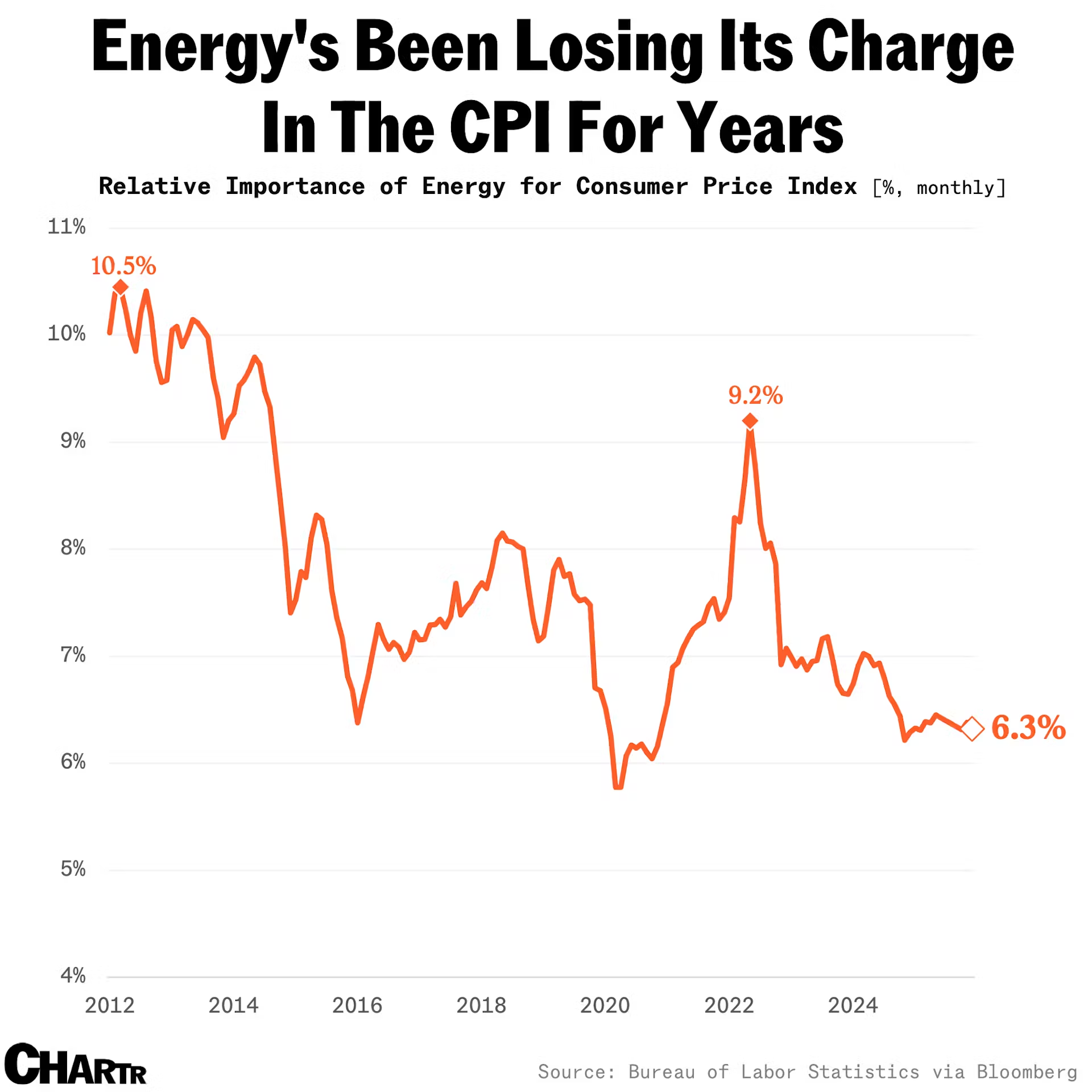

![[발표자료] GEO시대, 미디어채널 재설계 전략

- AI가 답하는 세상, 당신의 브랜드는 준비되었나요?](https://cdn.media.bluedot.so/bluedot.thecore/2025/09/povk3t_202509261048.jpg)

![[자료] AI 시대, 해외언론사들의 AI 도입 현황과 전략](https://cdn.media.bluedot.so/bluedot.thecore/2025/09/aqzesl_202509220109.10.png)

![[자료] AI 기반의 팩트체킹 방법론](https://cdn.media.bluedot.so/bluedot.thecore/2025/09/ebjijm_202509220114.18.png)

![[자료] AI 검색과 PR & 브랜드 마케팅의 대전환](https://cdn.media.bluedot.so/bluedot.thecore/2025/04/el4rkl_202504220930.25.png)

![[특강자료] PR 업무 현장에서의 AI 활용방안](https://cdn.media.bluedot.so/bluedot.thecore/2024/10/lwzhek_202410220533.JPG)

![[자료] 기자와 언론사를 위한 생성AI 활용 방안](https://cdn.media.bluedot.so/bluedot.thecore/2025/03/r69w3p_202503180637.00.png)